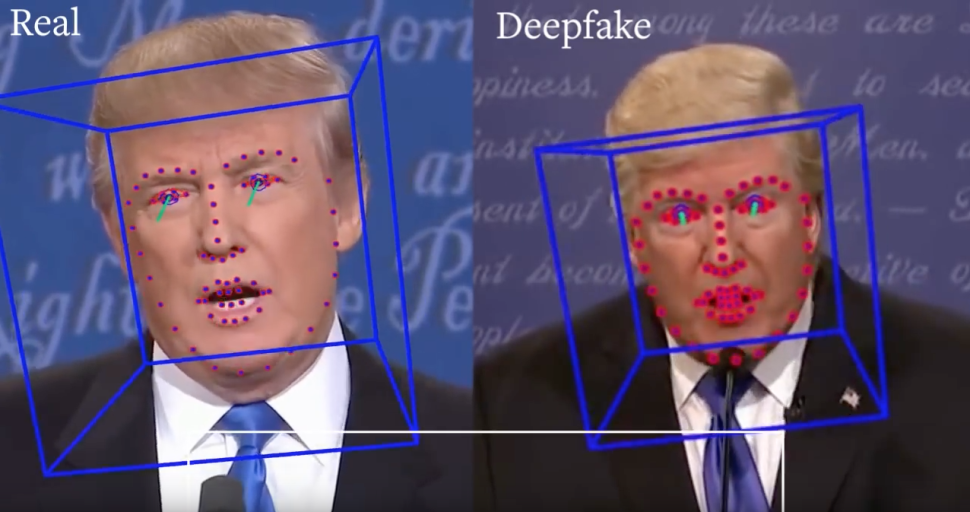

Un peu plus loin qu’un fakenews, un deepfake va jusqu’à truquer une vidéo dans laquelle le visage et la voix d’une personne connue sont falsifiés. Si la technique qu’utilise l’intelligence artificielle est une révolution numérique, elle constitue une menace dans la fausse information et la manipulation de l’opinion.

Le mot-valise, fusion de deep learning (apprentissage profond, technique d’intelligence artificielle) et fake (faux), désigne un contenu truqué et sciemment trompeur. La technique se fonde essentiellement sur la vidéo qui peut faire dire, avec des gestes à l’appui, ce qu’une personne n’a jamais dit et fait. En octobre dernier, dans une vidéo publiée sur les réseaux sociaux, on n’a vu le président Donald Trump annoncé « l’éradication du sida ». Cette vidéo que d’aucuns ont considéré comme une bourde du président américain est pourtant un deepfake. Les exemples sont nombreux.

Le mot-valise, fusion de deep learning (apprentissage profond, technique d’intelligence artificielle) et fake (faux), désigne un contenu truqué et sciemment trompeur. La technique se fonde essentiellement sur la vidéo qui peut faire dire, avec des gestes à l’appui, ce qu’une personne n’a jamais dit et fait. En octobre dernier, dans une vidéo publiée sur les réseaux sociaux, on n’a vu le président Donald Trump annoncé « l’éradication du sida ». Cette vidéo que d’aucuns ont considéré comme une bourde du président américain est pourtant un deepfake. Les exemples sont nombreux.

Les progrès de l’intelligence artificielle promettent la reproduction de plus en plus précise des caractéristiques propres aux humains. Dans un avenir proche, il est donc envisageable qu’un appel vidéo sur internet soit parfaitement manipulé par un deepfake.

« Jusqu’à présent, la vidéo était peut-être encore quelque chose qu’on pouvait croire. On se disait que c’était compliqué à modifier. Maintenant, ce sera encore un média auquel on ne pourra plus faire confiance », analyse Ewa Kijak, maître de conférences à l'Université de Rennes1 et chercheuse au laboratoire Irisa.

Le réalisme des images recomposées artificiellement fait d’un deepfake un instrument potentiellement efficace pour manipuler l’opinion.

La propagation des outils permettant de fabriquer des deepfakes serait donc une menace pour tous. En août dernier, le Wall Street Journal relatait qu’une entreprise avait été victime d’une tentative d’extorsion de fonds par des escrocs ayant utilisé une voix artificielle, imitant celle du président-directeur général. En Belgique, un deepfake, qui montre le président Trump inciter le pays à sortir de l’Accord de Paris sur le climat, a été utilisé par le Parti socialiste flamand mais le message avertissant de la supercherie n’a pas été entendu par de nombreux internautes.

Les outils de manipulation de l’audio et de la vidéo, pour faire dire n’importe quoi à n’importe qui, se perfectionnent et se multiplient. Pour tenter de contrer le phénomène, le géant américain Google, qui voit une grande menace dans cette nouvelle méthode, a publié en septembre dernier des milliers de deepfakes pour permettre aux chercheurs de travailler plus efficacement sur l’identification des contenus potentiellement « dangereux ». Le mastodonte américain a donc tourné des centaines de vidéos avec des acteurs. Il a, par la suite, transformé chaque séquence pour obtenir des centaines de vidéos truquées.

Cela suffit -il à lutter contre la menace qui pourrait bousculer toute les chaînes de production à l’avenir ? Ce qui est sûr, plusieurs recherches sont en cours dans le cadre de la détection des deepfakes. Dans le cadre de son programme MediFor, démarré en 2016, la Defense advanced research projects agency, une agence du Pentagone, finance plusieurs programmes de recherche sur l’exploration des deepfakes.

Mais plusieurs experts pensent que pour contrer le deepfake, il faut surtout intensifier la prévention par des programmes spécifiques. Une chose est certaine : il faudra encore plus redoubler de prudence avant de croire ce qu’on voit sur internet !